https://www.lifegate.it/deepfake-definizione-soluzione

- |

- Новый рубеж мистификаций и фейковых новостей — это дипфейки.

- Искусственный интеллект рискует породить городские легенды, которые сложно развеять

- Некоторые решения для защиты от дрейфа информации

«Что такое восприятие реальности?Это способность улавливать, обрабатывать и осмысливать то, что получают наши органы чувств?Если вы можете что-то услышать, увидеть, потрогать или понюхать, делает ли это это реальным?»Этот вопрос был задан в видео, опубликованном на Youtube в прошлом году. Морган Фриман, одна из старейших и самых известных звезд Голливуда.Разве что в конце ролика сам Морган Фримен заявил, что он не Морган Фримен:то, что только что получили наши чувства как зрителей, было дипфейком, то есть новым применением искусственного интеллекта и машинное обучение способен стирать границы между истиной и ложью.

Что подразумевается под дипфейком?

Этот термин быстро колонизировал средства массовой информации и большую часть нового общественного воображения, но что что такое дипфейки на самом деле?Для начала следует отметить, что, хотя мир заговорил об этом еще в годы, предшествовавшие пандемии Covid-19, дипфейки уже существовали и прогрессировали почти десятилетие:В 2014 году Ян Гудфеллоу, бывший глава подразделения искусственного интеллекта Apple, опубликовал научная статья который вводит концепцию «генеративно-состязательной сети» (или Ган, аббревиатура от «Генераторно-состязательная сеть»), конкретного применения машинное обучение в котором две нейронные сети «бросают вызов» друг другу в игре с нулевой суммой, которая позволяет им научиться генерировать новые изображенияЯ начинаю с существующего набора данных.А в 2017 году исследователи из многонациональной компании по производству видеокарт Nvidia усилили и сделали результаты сетей Gan более достоверными.

Это рождение дипфейка:такие сайты, как thispersondoesnotexist.com они предоставляют широкой публике дешевые инструменты фальсификации, беспрецедентные в истории человечества, и впервые мир осознает, что наши отношения с реальностью висят на волоске.«Глубокий», потому что нейронные сети этих инструментов генерации состоят из разных слоев:это глубокое обучение, эта форма искусственный интеллект что позволяет нам повторять черты лица и голоса реальных людей;«фейк», потому что, ну, не надо объяснений.

В ноябре 2017 года анонимный пользователь опубликовал на Reddit алгоритм, позволяющий создавать фальшивые, но реалистичные видеоролики:код попадает на популярный сайт обмена кодами GitHub, где он доступен каждому бесплатно.И с тех пор дипфейк проникает в первую крупную индустрию в котором он прославится:порно.Такие приложения, как FakeApp, позволяют любому вставить чужое лицо в компрометирующие видео, которые на первый взгляд кажутся реалистичными, создавая бесконечное количество рисков и много женоненавистничества:Скарлетт Йоханссон, несмотря на то, что она является одним из наиболее частых героев фейковых порнографических видеороликов, распространяемых по четырем углам Интернета, скажет, что борьба с ними — «безнадежное дело», учитывая, что «Интернет — это темная черная дыра, которая питается сама собой». ".

Какие дипфейки самые известные

С момента своих первых шагов «дипфейк» прошел долгий путь, и некоторые из его воплощений заставили общественное мнение усомниться в достоинствах и рисках, которые несет с собой эта новая технология:Помимо вышеупомянутого дипфейкового видео Моргана Фримена, работы голландцев Боба де Йонга и Боэта Шоувинка, по крайней мере, фальшивая капитуляция президента Украины Владимира Зеленского, распространенная Россией в прошлом году, и дипфейк актера Том Круз ставший последним писком моды в TikTok, созданный экспертом по спецэффектам Крисом Умом и Майлзом Фишером на основе сотен тысяч фотографий и видео голливудской звезды.

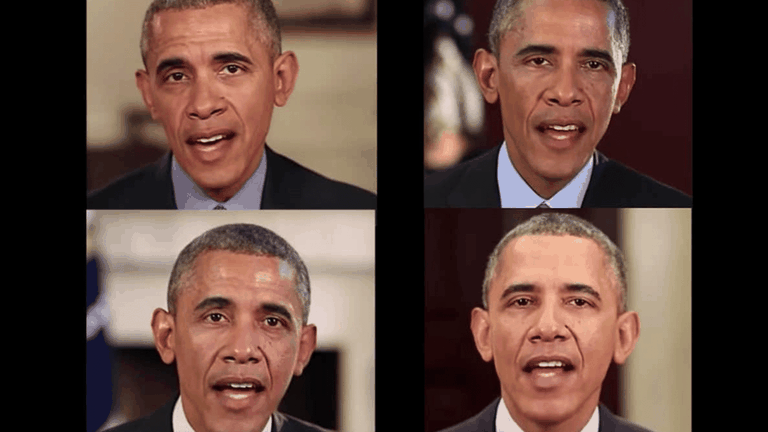

Дипфейк также появился на телевидении, еще больше расширив аудиторию, подвергающуюся его воздействию:за границей в сатирической программе «Субботний вечер в прямом эфире» был показан дипфейк Хиллари Клинтон в слезах совершенно неотличимо от настоящего видео, а в Италии Стриша ла Нотиция сделала то же самое с алгоритмически сгенерированным видео бывшего премьер-министра Маттео Ренци.В 2018 году интернет-газета Buzzfeed вместо этого распространила фальшивый, но реальный клип с Бараком Обамой, который только в конце показал, что его играет актер Джордан Пил.

Риски дипфейков

«С большой силой приходит и большая ответственность», — сказал известный супергерой комиксов, и то же самое относится и к неизвестному, которое маячит на горизонте дипфейков.Что произойдет, если тысячи, а возможно, даже миллионы людей поверят фейковому видео, на котором политический лидер объявляет ядерную войну?А до этого:что станет с нашим отношения с реальностью, теперь, когда то, что мы видим и слышим, уже не является «истиной» по определению?

Даже в наших широтах, во времена дипфейка Маттео Ренци на Striscia la Notizia, многие наблюдатели отмечали, что несколько двусмысленная подача контента в прайм-тайм может породить недоразумения с серьёзными последствиями:У Wired было это определенный «еще один вызов для журналистики и общественного мнения в целом».

Но за границей, как это часто бывает, дебаты о дипфейках зашли гораздо дальше, чем то, что попадает на первые полосы в Италии:в прошлом году впервые масштабная кампания видео с фальшивыми, необычно прокитайскими телевизионными актерами заполонили англоязычные Facebook и Twitter, открыв новый и тревожный фронтинформационная война геополитический.

Кто спасет нас от нашествия ультрафейков?

Вы их конечно не читаете, по крайней мере пока:единственный штат, прошедший срочные меры попытаться остановить это явление - это Китай, который ранее в этом году сделал обязательным получение согласия «фальсифицированного» лица и использование отличительных знаков, таких как водяные знаки, которые свидетельствуют о поддельном характере произведения.Но у дракона есть те же проблемы, что и у остального мира:Как нам остановить явление, самые свирепые злоумышленники которого часто действуют анонимно, на гибких платформах, где контент множится так быстро, что они могут действовать почти беспрепятственно?

Что-то, если не что-то другое, начинает двигаться и в старой Европе: Закон об искусственном интеллекте, только что одобренный Парламентом ЕС, направлен на введение нового международного стандарта регулирования и прозрачности приложений искусственного интеллекта.Но много частей его текста являются предметом споров и юридических сомнений:трудно определить масштабы того, что можно назвать «искусственным интеллектом», не говоря уже о том, насколько сложно его регулировать.А пока, короче, тем фото и видео несуществующих людей суждено творить хорошую и плохую погоду:и мы, как в великом классике Сан-Ремо, больше не видим реальности.

Как распознать дипфейк

Столкнувшись со всеми этими рисками, остается только понять как защитить себя из дипфейков:что совсем не просто, и с экспоненциальным прогрессом их будет становиться все меньше и меньше (в последнем Photoshop Adobe представила генеративную функцию, способную создавать фотомонтажи, почти неотличимые от реальности).

На момент написания у основных искусственных интеллектов все еще есть некоторые проблемы с сдача рук человеческих существ:Если вы видите на конце верхней конечности что-то странное, не исключайте, что это может быть подделка.

Мит рекомендует, среди прочего, из обратите внимание на кожу на лице главных героев предполагаемых дипфейков:если оно кажется слишком узким или, наоборот, слишком морщинистым или с разной степенью старения в разных частях лица, то есть большая вероятность, что это изображение или это видео ненастоящее.И даже моргание и движение губ могут дать хорошие указания в этом смысле.